October 21, 2025

Au-delà de l’opposition innovation/régulation, un regard nuancé sur la prise de conscience éthique et responsable de la Silicon Valley.

Depuis des années, un refrain revient dans le monde de la tech : « Les États-Unis innovent, l’Union européenne régule. » Cette formule, si elle n’est pas totalement fausse, réduit à l’excès une réalité bien plus nuancée, en particulier en matière d’Intelligence Artificielle. La Silicon Valley incarne certes le moteur historique de l’innovation en IA, mais elle représente également un véritable laboratoire d’initiatives éthiques, de plaidoyers d’organisations à but non lucratif et de réorientations institutionnelles visant à guider le développement de l’IA vers un avenir plus responsable et centré sur l’humain. Cet article met en lumière plusieurs des initiatives éthiques émergeant dans la région de la Bay Area et au-delà. Ensemble, elles démontrent que la Silicon Valley ne se contente pas de produire les prochaines générations d’outils d’IA, elle contribue aussi à poser les bases d’une réflexion sur la manière dont nous choisissons de vivre avec ces technologies.

Le combat d’Everyone.AI s’impose aujourd’hui comme l’un des plus urgents : protéger et autonomiser les enfants à l’ère de l’intelligence artificielle. Sa mission est de faire en sorte qu’au sein de la région de la Baie et dans le monde, l’IA soit pensée avec un regard profondément centré sur l’enfant et le jeune. L’objectif : que les enfants et les adolescents ne soient pas de simples usagers passifs, mais des acteurs à part entière, dont les besoins fondamentaux en matière de développement sont reconnus, protégés et respectés. En effet, contrairement aux adultes, ceux-ci disposent encore d’une maturité cognitive incomplète, d’une conscience limitée des enjeux liés à la vie privée et de protections juridiques insuffisantes face à ces outils.

Everyone.AI contribue en:

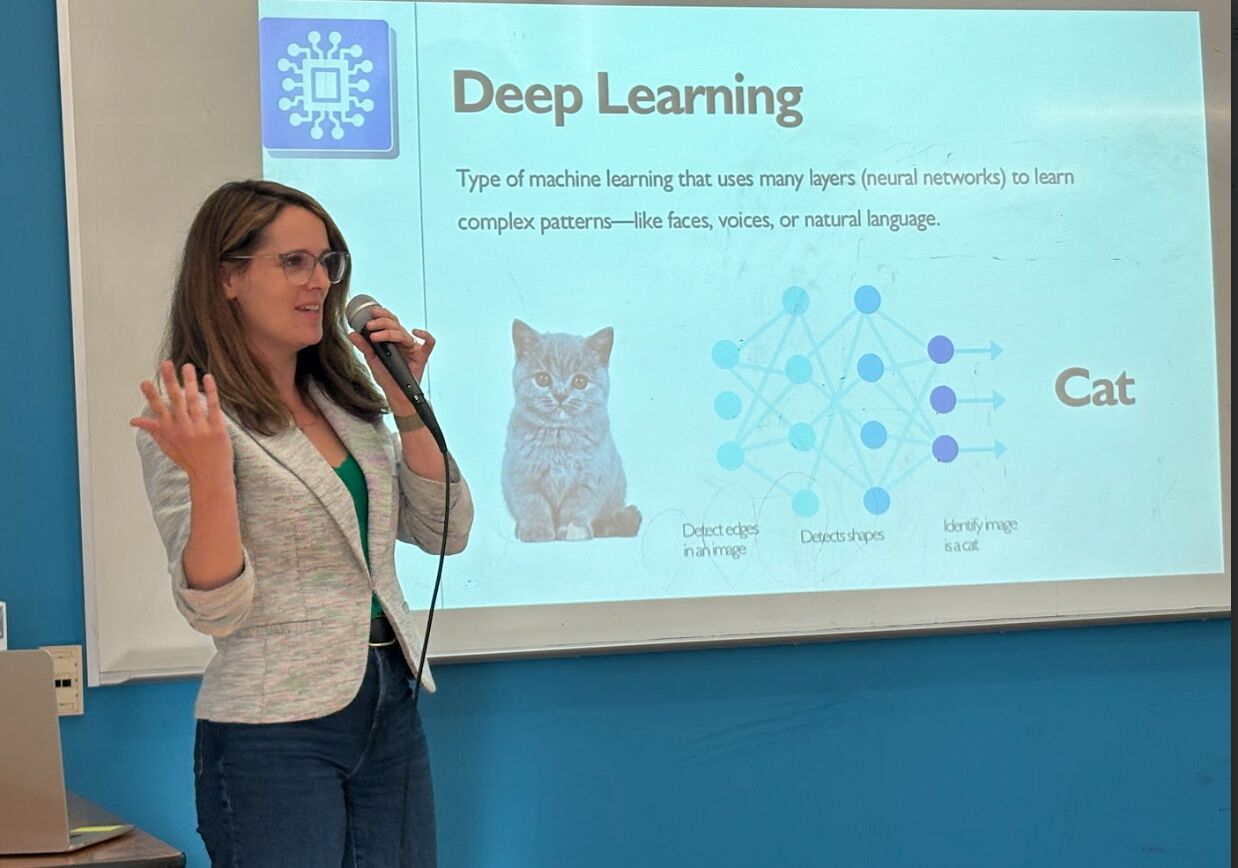

- Sensibilisant: L’organisation met en lumière les risques spécifiques auxquels les enfants sont exposés: biais algorithmiques, fuite de données personnelles, addiction aux écrans, manipulation psychologique via des contenus ultra-personnalisés. Elle propose des ressources pédagogiques accessibles et anime des ateliers à destination des parents, enseignants et décideurs.

- Favorisant la collaboration intersectorielle: Elle tisse des ponts entre développeurs, législateurs, psychologues, enseignants, et même les jeunes eux-mêmes, pour définir ensemble ce que devrait être une IA éthique pour les enfants, et comment la mettre en œuvre.

- Militant pour des standards de design centrés sur les enfants: Elle défend des systèmes d’IA qui tiennent compte de la maturité émotionnelle des enfants, de leur droit à la vie privée et de leur besoin de sécurité. Cela inclut des règles adaptées à l’âge pour la gestion des données, des options de refus, des algorithmes transparents et une séparation claire entre divertissement et éducation.

Dans un monde où les enfants incarnent à la fois les premiers adoptants et les futurs utilisateurs de long terme de l’intelligence artificielle, Everyone.AI nous rappelle que l’enjeu n’est pas seulement ce que nous construisons, mais pour qui nous le construisons. Cette initiative illustre l’évolution du débat éthique: elle propose une démarche à la fois concrète et entrepreneuriale, tournée vers l’intérêt collectif, tout en plaçant l’éthique au cœur de son action.

La protection des enfants portée par Everyone.AI s’inscrit dans un ensemble plus vaste d’initiatives qui, depuis la Baie de San Francisco, cherchent à réorienter l’innovation technologique vers l’intérêt général. Cette constellation d’acteurs associe ONG, chercheurs, institutions académiques et entreprises engagées, et illustre la diversité des approches en matière d’éthique de l’IA.

Le Center for Humane Technology (CHT) en est l’un des exemples les plus influents. Fondé en 2018 par trois figures de la Silicon Valley: Tristan Harris, ex-éthicien du design chez Google ; Aza Raskin, co-créateur du défilement infini ; et Randy Fernando, ancien cadre chez NVIDIA — le CHT a su transformer une critique interne des plateformes en mouvement mondial. Sa démarche repose sur deux axes:

- Clarifier les mécanismes invisibles: en expliquant comment les modèles économiques fondés sur la publicité et l’engagement incitent à des pratiques manipulatrices (lecture automatique, notifications incessantes, exploitation des biais cognitifs), il aide citoyens, médias et législateurs à comprendre que ces dérives ne sont pas accidentelles mais structurelles.

- Transformer ces mécanismes: par le plaidoyer politique, les propositions réglementaires, l’action éducative à grande échelle (notamment avec le documentaire The Social Dilemma), et une veille attentive sur les risques émergents comme les médias synthétiques, l’IA générative manipulatrice ou la polarisation politique. Son objectif est d’imposer des standards de design centrés sur le bien-être, une transparence accrue et une régulation du capitalisme de surveillance.

Autour du CHT gravitent d’autres initiatives qui complètent et enrichissent cette dynamique:

- Santa Clara University a créé un master inédit alliant ingénierie de l’IA et enseignements sur l’éthique, l’équité et l’impact sociétal, afin de former des ingénieurs capables de se demander non seulement comment créer une IA, mais aussi s’il faut la créer.

- Encode, entre la Californie et Washington D.C., mobilise citoyens et décideurs dans une démarche civique et participative, pour traiter les risques systémiques posés par l’IA.

- Black in AI, réseau mondial très actif dans la Baie, lutte contre les biais présents dans les données, les algorithmes et les processus de recrutement, en donnant de la visibilité et des moyens aux chercheurs et ingénieurs issus de minorités.

- Hugging Face & d'autres fournisseurs de solutions d'IA, enfin, mettent la puissance de l’open source au service du bien commun, en développant des projets orientés vers l’accessibilité, la protection de l’environnement et la lutte contre la désinformation, transformant ainsi des outils conçus par la Big Tech en véritables biens publics.

Si la Silicon Valley reste le cœur battant de l’innovation technologique, elle est aussi traversée par une prise de conscience éthique grandissante. De la protection des enfants à la transparence des algorithmes, en passant par l’inclusion des minorités et la mobilisation citoyenne, ces initiatives rappellent que l’avenir de l’IA ne se joue pas uniquement dans les laboratoires de recherche ou les salles de marché, mais aussi dans les choix de société que nous faisons collectivement.

Ainsi, plutôt que d’entretenir l’idée d’un clivage irréconciliable, l’expérience californienne suggère une autre voie: celle d’un équilibre où l’innovation technique et la responsabilité sociale se nourrissent mutuellement. Dans ce dialogue permanent entre créativité et éthique, la Silicon Valley n’est pas seulement un producteur d’outils, mais aussi un terrain d’expérimentation politique, sociale et culturelle qui inspire bien au-delà de ses frontières.